另一個負面影響,將會是真相和謊言的混淆。在這個可怕的 POST-TRUTH年代 ,「 真實」 已經變得不是最重要; 而 POST-TRUTH 早已漸漸由政治舞台蔓延至日常生活。當播放速度都可以令PELOSI 被 無 辜 「 灌 醉 」, 像真度高的 DEEP FAKE,將可以怎樣操縱觀眾的情緒、想法,甚至捏造、無中生有出對自己有利對別人有害的「真相」? 在選舉之中, 當然是大有可為。尤其知名人士的聲音和圖片,實在俯拾皆是。我們活在一個硬照也要時刻 FACT CHECK的年代,獲得真相的難度愈來愈高。更不用説 ,「已FC」 都以是錯的 ; 再説,有多少人對真假如此警惕? 不執著FACT CHECK而又不細心閱讀消息的人隨處可見。還記不記得721元朗站孕婦事件? 記不記得有那麼多的人炒了多少次車?

除 了 「 無中生有 」, 還有 「 從來沒有 」。 2016年美國總統大選前夕,時機巧妙地出現了一條2005年 TRUMP疑似出言侮辱女性的片段。TRUMP起初道 歉,可是到2017年轉口風,質疑該片段的真確性⸺ 會不會有一天,”DEEPFAKE”可以是辯護/否認/ 無賴的理由? 因為可以預測,DEEPFAKE只會愈來愈普及,愈來愈難辨真假,技術成本愈來愈低。如果有一天,警方有片段顯示,所有30歲以下的暴徒都涉嫌將國旗拋到海裏以及「污損」國徽,咁點算? 而家都已經唔知點算。這裏容許我引用《CHERNOBYL》 (2019)的名言:

What is the cost of lies? It's not that we'll mistake them for the truth. The real danger is that if we hear enough lies, then we no longer recognize the truth at all.

雖 然聽過很多次,但此話確實不假。

對 策

說得很恐怖,但希望還是有的。首先針對偽造成人影片方 面,立法途徑暫時仍有困難。美國已經有州份通過禁止 DEEPFAKE影片的傳播;但在法律層面而言,因為身體不 屬於頭像當事人,嚴格來說並沒有侵犯頭像擁有者的隱私。 尤其好像香港這些地區,是沒有肖像權的。美國當局也很快 意識潛在危機,作出應對;隸屬美國國防部的軍事科技研究 機構DARPA已連同多個組織和機構,正着手研究近70個反 DEEPFAKE的技術。其中一個最直接的方法,就是以人工 智能偵測人工智能,訓練人工智能辨識經過DEEPFAKE的 數碼內容。而且像TWITTER和PORNHUB這些最大型的 網站,都已經禁止DEEPFAKE內容的散播。又或者進階一 點,將已經查證的真實影片上存到BLOCKCHAIN,防止影 片被人篡改。

造福世界的可塑性

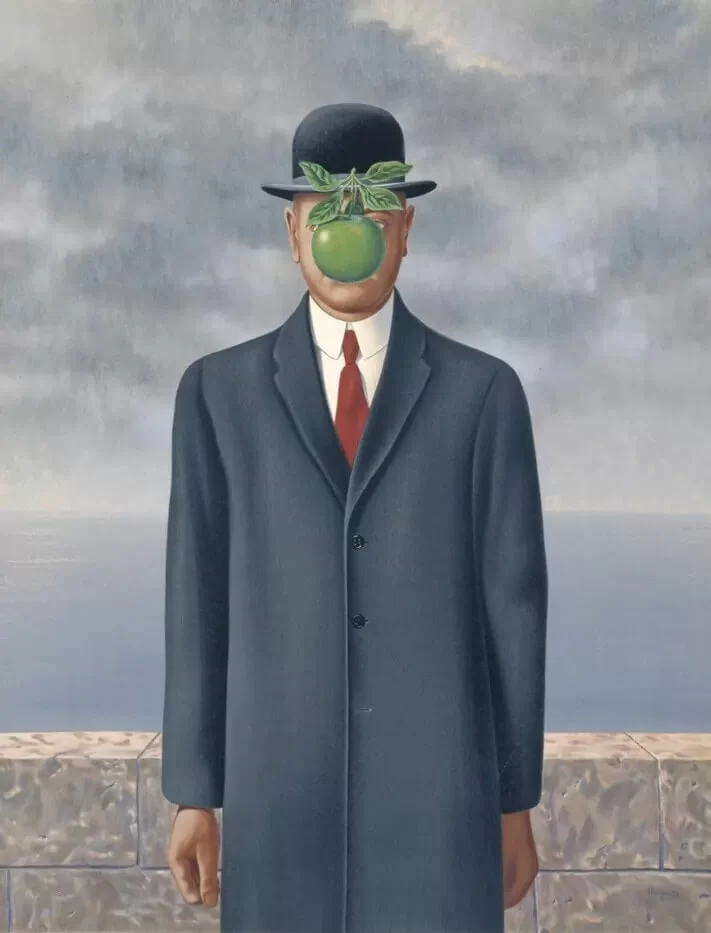

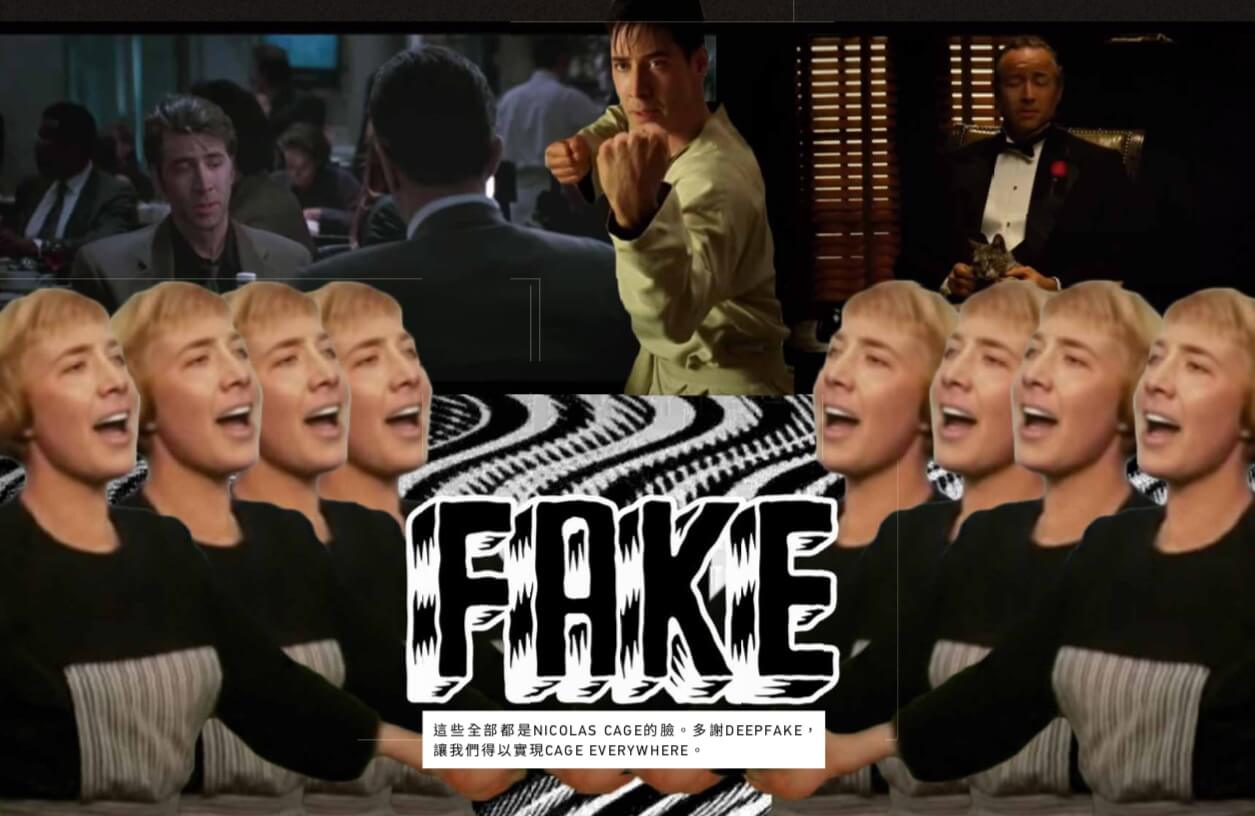

當然,情況不是一面倒的敗壞,善用DEEPFAKE也能帶來很多 好的可能性。首要當然是更多創意的實現,更多影像的可能性, 更多人可以利用電腦改圖以實現創意。當中有人以DEEPFAKE 將NICOLAS CAGE的面孔放到不同電影的角色裏;為何 是NICOLAS CAGE ? 因為他已成CULT ICON,AND BECAUSE WHY NOT ?然後還有一間名為CEREPROC的公 司,專注於聲音合成的研究,失聲的人有望重拾聲音。又例如 以DEEPFAKE重現已死的人的影像和聲音,位於FLORIDA的 SALVADOR DALÍ MUSEUM就「復活」了DALÍ; 又或者想 像一下,STEVE JOBS的身影可以重現於WDCC等等……

而每個人都可以做到的是,不完全證實的重大消息,就不要 廣傳。我們很可能已經進入了《BLACK MIRROR》式的 TECHNOLOGICAL DYSTOPIA,讓我學JORDAN PEELE說 一句:”STAY WOKE B*TCHES.”

Comments